Jak zmieniła się codzienna praca programisty po wejściu AI

Programista „przed AI” a programista „z AI”

Jeszcze kilka lat temu typowy dzień pracy programisty polegał w dużej mierze na ręcznym pisaniu kodu, szukaniu przykładów w sieci, przeglądaniu dokumentacji i samodzielnym debugowaniu. Część zespołów korzystała z prostych podpowiedzi w IDE, ale były to raczej inteligentniejsze autouzupełnianie i szablony niż faktyczna sztuczna inteligencja rozumiejąca kontekst.

Obecnie, przy dobrze wdrożonych narzędziach AI, programista rzadziej pisze długie fragmenty kodu „od zera”. Duża część czasu przesuwa się w stronę:

- formułowania precyzyjnych próśb (promptów) do asystentów programistycznych,

- oceny wygenerowanych propozycji kodu i ich dopasowywania do projektu,

- projektowania architektury i decyzji technicznych „z wyprzedzeniem”,

- sprawdzania testów i integracji zamiast pojedynczych linijek.

Zmienia się więc charakter pracy: mniej żmudnego pisania i wyszukiwania, więcej kuratorowania, recenzowania i myślenia o konsekwencjach. Dla części osób jest to naturalne przejście, dla innych – wymaga przestawienia nawyków i sposobu pracy.

Przesunięcie z „kodera” na projektanta rozwiązań

Sztuczna inteligencja przejmuje w dużej mierze czynności, które są powtarzalne i można je opisać w postaci jasnego celu: „wygeneruj handler HTTP dla tego endpointu”, „napisz testy jednostkowe dla tej funkcji”, „przepisz to z Pythona na TypeScript”. Tam, gdzie da się sformułować dość konkretny opis oczekiwanego efektu, AI zwykle potrafi dostarczyć sensowny szkic rozwiązania.

Rola programisty przesuwa się w stronę projektowania interfejsów, modułów, kontraktów i struktur danych. To człowiek decyduje, czy dany fragment w ogóle powinien powstać, jak będzie utrzymywany, jakie ma ograniczenia i gdzie są potencjalne skutki uboczne. Inaczej mówiąc: największą wartością programisty staje się umiejętność zadania dobrego pytania i oceny odpowiedzi, nie samo szybkie pisanie kodu.

W praktyce sporo zespołów zaczyna stosować podejście, w którym najpierw dokładnie opisuje się funkcjonalność (np. w komentarzu lub dokumencie), a dopiero potem prosi narzędzie AI o wygenerowanie kodu bazowego. Taka zmiana wymusza większą dyscyplinę analityczną, ale znacząco przyspiesza implementację prostszych elementów.

Wpływ AI na juniorów, midów i seniorów

Dla osób na różnych poziomach doświadczenia skutki wejścia AI są inne. Juniorzy zyskują szybki dostęp do „mentora na żądanie”, który tłumaczy podstawy, proponuje przykładowe rozwiązania i pomaga w zrozumieniu obcych projektów. Jednocześnie pojawia się ryzyko, że junior przestanie świadomie uczyć się fundamentów i będzie „kleić” rozwiązania z podpowiedzi, nie rozumiejąc w pełni, co się dzieje pod spodem.

Mid developerzy zwykle odczuwają największy wzrost produktywności. Mają już na tyle doświadczenia, żeby oceniać jakość propozycji AI i widzą, jak wiele czasu zyskują przy generowaniu szkieletów kodu, testów czy przy szybkim researchu. Jednocześnie potrafią jeszcze dość elastycznie dopasowywać swój workflow do nowych narzędzi.

Seniorzy z kolei coraz częściej zajmują się projektowaniem architektury, weryfikowaniem decyzji i kontrolą jakości rozwiązań generowanych z pomocą AI. Dla nich asystenci programistyczni są bardziej narzędziem do analizy (np. code review, refaktoryzacja, analiza ryzyk), niż prostym generatorem kodu. Równolegle część seniorów obawia się spłaszczenia różnic kompetencyjnych – skoro „każdy” może wygenerować poprawnie działający fragment, trudniej pokazać wartość zaawansowanego warsztatu.

Co realnie przyspiesza AI, a co nadal wymaga człowieka

Asystenci programistyczni znakomicie sprawdzają się w zadaniach typu:

- powtarzalne wzorce (CRUD, DTO, mapery, konfiguracje),

- pisanie testów na podstawie istniejącego kodu,

- przekład kodu między językami lub frameworkami,

- podpowiedzi składni i prostych algorytmów.

Znacznie gorzej radzą sobie tam, gdzie trzeba uwzględnić kontekst biznesowy, długoterminowe skutki, niuanse domenowe lub niepełne wymagania. AI nie zna Twojej organizacji, historii projektu, relacji z klientem ani polityki bezpieczeństwa. Wszystko to nadal wymaga świadomej decyzji człowieka.

Podstawy: jak działają narzędzia AI używane przez programistów

Model językowy i przewidywanie kolejnych tokenów

Większość nowoczesnych narzędzi AI dla programistów opiera się na dużych modelach językowych (LLM – Large Language Models). Taki model nie ma „świadomości” ani faktycznego rozumienia kodu. Jego zadaniem jest przewidzieć najbardziej prawdopodobną sekwencję kolejnych tokenów (czyli cząstek tekstu, często fragmentów słów lub symboli), biorąc pod uwagę to, co już zostało wpisane.

W praktyce oznacza to, że gdy wpisujesz początek funkcji lub opisujesz problem naturalnym językiem, model „kojarzy” wzorce z ogromnej liczby przykładów, na których był trenowany, i na tej podstawie uzupełnia Twój kod lub odpowiedź. Z perspektywy użytkownika wygląda to jak „rozumienie”, ale technicznie to statystyczne przewidywanie tekstu zgodnego z kontekstem.

Generowanie kodu a rozumienie kontekstu projektu

Istotne jest rozróżnienie między lokalnym kontekstem (np. kilka sąsiadujących plików, fragment klasy) a globalnym kontekstem projektu (całe repozytorium, historia decyzji architektonicznych, zależności między modułami). Większość dostępnych narzędzi działa w obrębie okna kontekstowego, które ma ograniczony rozmiar.

Jeżeli asystent w IDE widzi tylko bieżący plik i kilka pobliskich definicji, jest w stanie dość dobrze zaproponować kolejną metodę czy test. Natomiast nie będzie wiedział, że w innym module istnieje już podobna funkcja, której należałoby użyć, aby nie powielać logiki. AI nie buduje pełnego modelu mentalnego całego systemu, lecz pracuje na wycinkach kodu przekazanych w danym zapytaniu.

Bardziej zaawansowane rozwiązania potrafią indeksować repozytorium, własną dokumentację i historię commitów, a następnie tworzyć skrócony „obraz” projektu, który jest wysyłany do modelu. Mimo to nadal obowiązuje ograniczenie długości kontekstu i związane z tym ryzyko, że model „zapomni” o części danych albo nada im niewłaściwy priorytet.

Rodzaje narzędzi: wtyczki, chatboty, aplikacje webowe i API

W codziennej pracy programisty używa się zwykle kilku kategorii narzędzi AI równolegle:

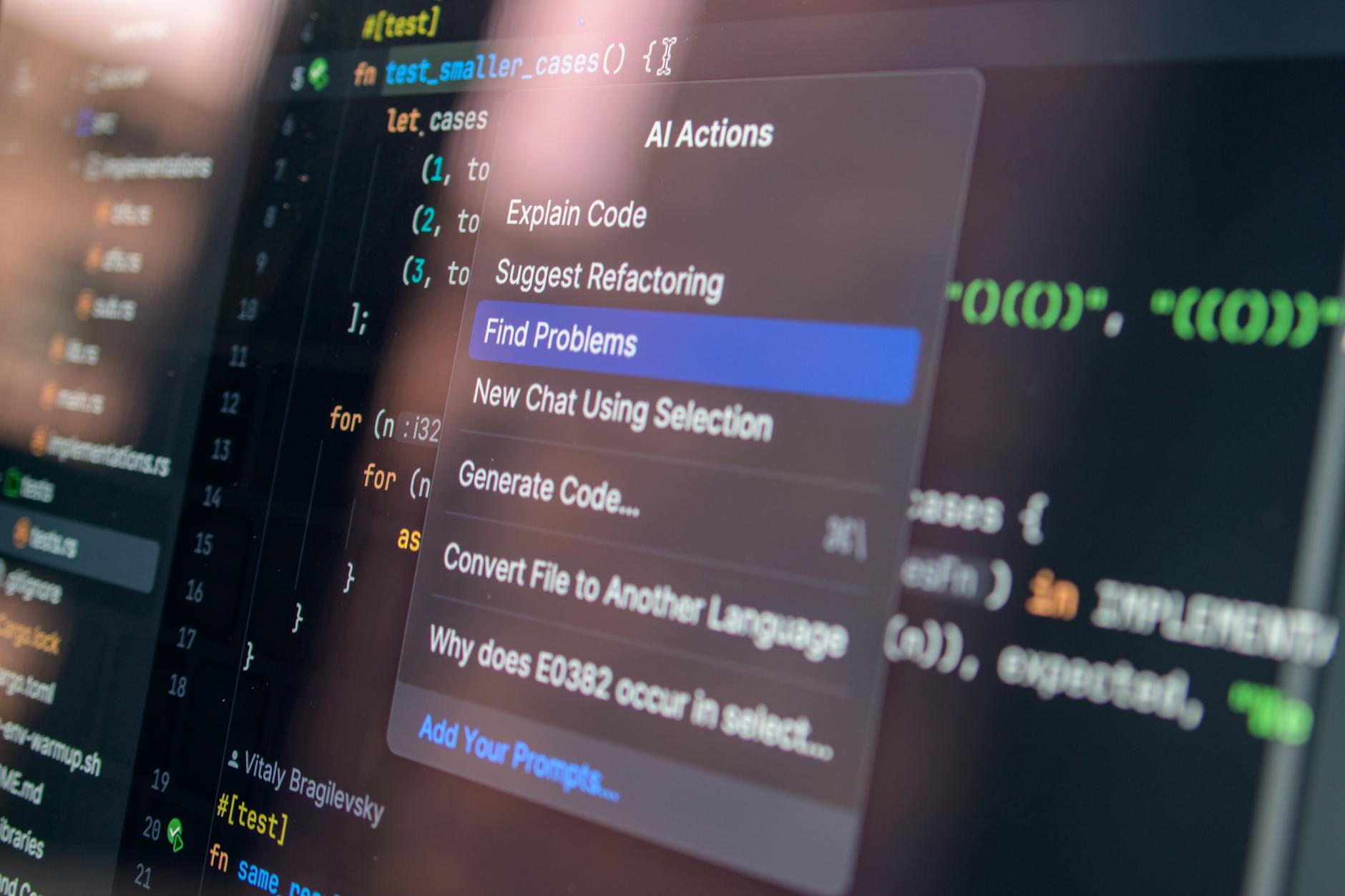

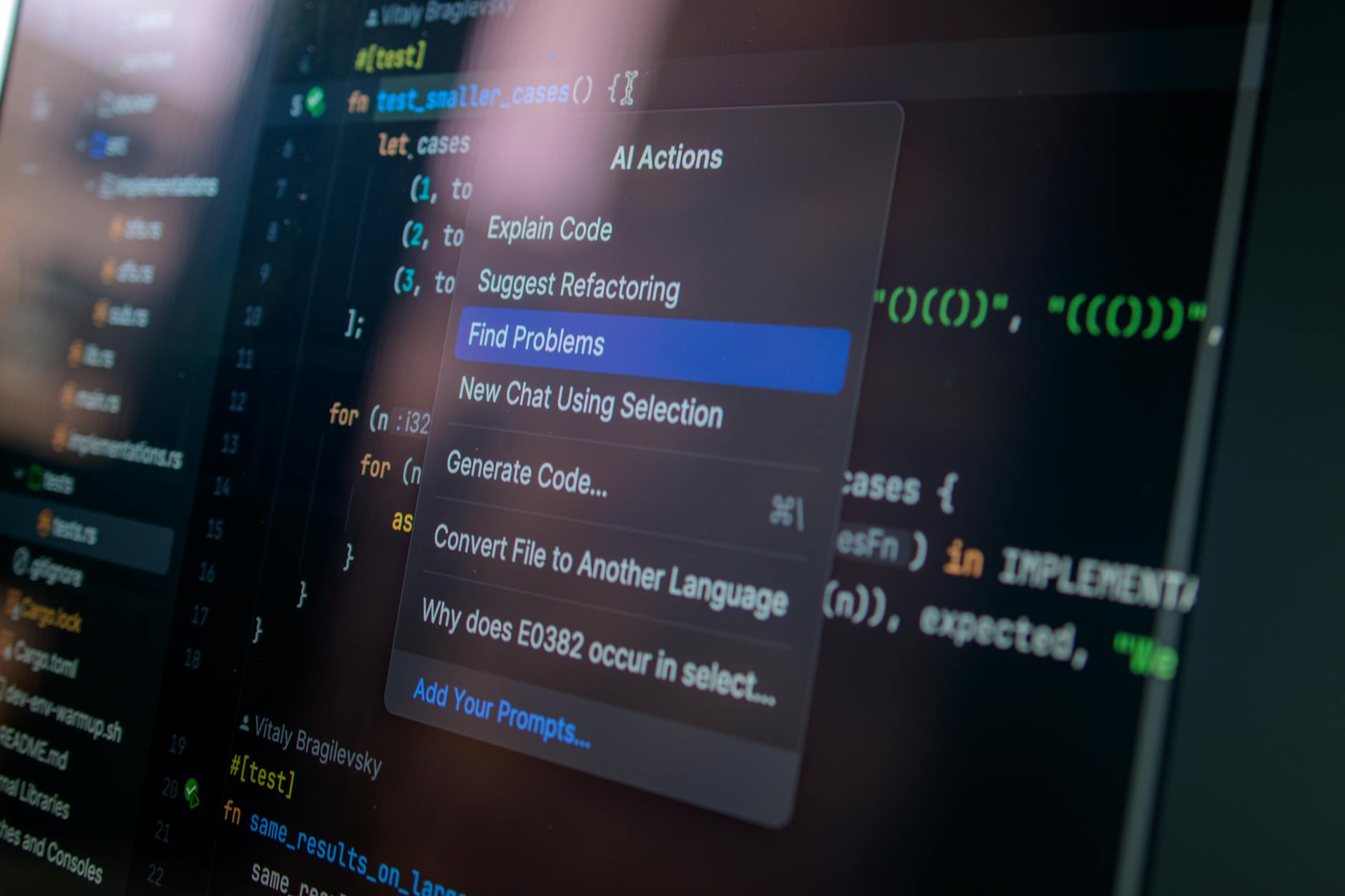

- Wtyczki do IDE (VS Code, IntelliJ, Rider i inne) – zapewniają podpowiedzi „inline”, uzupełniają funkcje, proponują testy bezpośrednio w edytorze.

- Chatboty i asystenci konwersacyjni – działają w przeglądarce lub jako osobne aplikacje, pozwalają wklejać większe fragmenty kodu, prosić o refaktoryzację, wyjaśnienie algorytmu czy sugestie architektury.

- Narzędzia webowe – specjalizowane serwisy do analizy logów, generowania dokumentacji, diagramów lub migracji między technologiami.

- Interfejsy API – integracje bezpośrednio w procesie CI/CD, np. automatyczne podsumowanie pull requestów, generowanie opisów wydań, etykietowanie ticketów.

Dobór narzędzi zwykle zależy od kultury pracy zespołu. Część organizacji pozwala na swobodne korzystanie z zewnętrznych chatbotów, inne wprowadzają dedykowane, zamknięte instancje modeli, aby ograniczyć ryzyko wycieku danych wrażliwych.

Ograniczenia techniczne i „halucynacje”

Modele językowe mają kilka kluczowych ograniczeń, o których trzeba stale pamiętać:

- Ograniczone okno kontekstu – model „widzi” jedynie określoną liczbę tokenów. Jeżeli projekt jest duży, fragmenty mogą być obcinane lub streszczane, co prowadzi do uproszczeń.

- Halucynacje – model potrafi generować przekonujące, ale fałszywe informacje: nieistniejące opcje konfiguracyjne, metody, flagi lub całe biblioteki. Dzieje się tak, ponieważ jego celem jest spójna odpowiedź, nie weryfikacja faktów.

- Brak natywnego dostępu do repozytorium – o ile nie skonfigurowano specjalnych integracji, model nie „zna” kodu, który nie został wprost dostarczony w zapytaniu.

- Brak świadomości czasu – model nie aktualizuje na bieżąco swojej wiedzy o najnowszych wersjach bibliotek czy frameworków, chyba że dostarczysz mu dokumentację wprost.

Z tego powodu asystenci programistyczni powinni być traktowani jak bardzo sprawny, ale czasem mylący się współpracownik, a nie jak nieomylne źródło prawdy. Każdą krytyczną sugestię należy skonfrontować z dokumentacją, testami i własnym doświadczeniem.

AI jako partner przy pisaniu kodu – scenariusze użycia „na klawiaturze”

Uzupełnianie kodu inline w IDE

Najbardziej namacalne przyspieszenie pracy daje uzupełnianie kodu „inline”. Po wpisaniu kilku pierwszych znaków funkcji lub komentarza, AI potrafi zaproponować całą implementację, uwzględniając istniejące nazwy zmiennych, bibliotek i styl projektu. W prostych przypadkach wystarczy zaakceptować podpowiedź jednym skrótem klawiaturowym.

W praktyce, przy dobrze skonfigurowanych narzędziach, można osiągnąć sytuację, w której:

W tym miejscu przyda się jeszcze jeden praktyczny punkt odniesienia: Przewodnik po licencjach open source: MIT, Apache, GPL i co to oznacza w praktyce.

- piszesz nagłówek funkcji i jej krótki opis w komentarzu,

- asystent proponuje kompletną implementację,

- Ty jedynie poprawiasz szczegóły i dodajesz specyficzne przypadki.

Co do zasady sprawdza się to najlepiej w kodzie „klejącym” – integracje API, obsługa formularzy, serializacja, proste transformacje danych. Przy złożonych algorytmach, domenie finansowej czy krytycznych fragmentach systemu rozsądniej traktować propozycje AI jako punkt wyjścia do własnego rozwiązania.

Generowanie szkieletów klas, endpointów i zapytań

Projektując nowe moduły, wiele czasu zabierają powtarzalne elementy: szablony kontrolerów, repozytoriów, serwisów, konfiguracja DI, definicje DTO. Asystent AI może na podstawie kilku zdań opisu wygenerować komplet takich szkieletów: klasy, interfejsy, podstawowe metody, a nawet przykładowe logowanie błędów.

Podobnie jest z zapytaniami SQL czy migracjami baz danych. Wystarczy opisać strukturę tabel lub oczekiwany wynik, a model proponuje odpowiednie SELECT-y, JOIN-y, CTE czy indeksy. Następnie programista dopasowuje je do konkretnej bazy (PostgreSQL, MySQL, SQL Server) i optymalizuje pod realne dane.

Dobrą praktyką jest utrzymywanie zestawu promptów lub opisów, które zespół stosuje do generowania takich szablonów w spójny sposób. Z czasem powstaje „biblioteka” zapytań do AI, która skraca wejście w projekt nowym osobom.

Przepisywanie kodu między językami i stylami

Częstym zadaniem jest migracja fragmentów logiki z jednego języka na inny lub ze starego frameworka do nowszego. Ręczne przepisywanie bywa żmudne i sprzyja wprowadzaniu błędów. AI opanowuje takie transformacje całkiem sprawnie – pod warunkiem, że fragmenty są sensownie odizolowane i dobrze opisane.

Asystent można poprosić na przykład: „przepisz tę funkcję z Pythona do Node.js z użyciem async/await, zachowując tę samą logikę błędów”. Po wygenerowaniu kodu należy go jednak przejrzeć pod kątem różnic w obsłudze wyjątków, typach danych, bibliotekach do I/O itp. AI często poprawnie oddaje strukturę, ale może pomylić szczegóły specyficzne dla danego środowiska.

Przykład: prosty serwis REST z pomocą asystenta

Wyobraźmy sobie zadanie: implementacja prostego serwisu REST do zarządzania zadaniami (to-do). Programista opisuje w komentarzu: „Serwis REST do zarządzania zadaniami: lista, tworzenie, aktualizacja statusu, usuwanie. Uwierzytelnianie tokenem, walidacja podstawowych pól”. Następnie prosi asystenta AI o:

- wygenerowanie kontrolera HTTP z endpointami,

- stworzenie prostego modelu danych i interfejsu repozytorium,

- napisanie testów jednostkowych dla kontrolera z użyciem mocków.

AI zwykle poprawnie wygeneruje szkielety metod, podstawową walidację i przykładowe testy. Zadaniem człowieka będzie:

- sprawdzenie, czy uwierzytelnianie jest zgodne z polityką bezpieczeństwa projektu,

Doprecyzowywanie implementacji na podstawie komentarzy i przykładów

Po wygenerowaniu szkieletu kodu AI dobrze sprawdza się przy „dopieszczeniu” szczegółów. Zamiast ręcznie dopisywać kolejne warianty zachowania, można je opisać w komentarzach, jako krótkie scenariusze lub przykładowe wejścia/wyjścia. Model jest zwykle w stanie dopasować implementację do takich opisów.

Przykładowy sposób pracy:

- dodajesz nad metodą komentarz typu:

// jeśli użytkownik nie ma uprawnień, zwróć 403 zamiast 404, - podajesz w komentarzu 2–3 przykłady wywołań z oczekiwanym wynikiem (tzw. doctesty lub pseudotesty),

- prosisz asystenta o zaktualizowanie implementacji tak, aby spełniała opisane scenariusze.

Taki tryb pracy zmusza do precyzyjnego formułowania wymagań, a jednocześnie wykorzystuje moc generatywną modelu do pisania kodu „pod opis”, zamiast odwrotnie.

Projektowanie API i kontraktów domenowych z naturalnego języka

Część programistów wykorzystuje asystentów do wstępnego projektowania kontraktów – zarówno REST/GraphQL, jak i interfejsów domenowych. Zamiast od razu pisać klasy, można zacząć od swobodnego opisu procesów biznesowych, a dopiero potem poprosić AI o zaproponowanie:

- struktur request/response,

- nazw pól i typów danych,

- rozsądnych kodów błędów i ich komunikatów,

- wstępnej walidacji (np. zakresy wartości, obowiązkowe pola).

W praktyce wygodne jest iteracyjne zawężanie wymagań: najpierw ogólny opis procesu (np. „proces wnioskowania o kredyt”), potem doprecyzowanie wyjątków i scenariuszy negatywnych, a na końcu przejście do konkretnego języka i frameworka. AI przyspiesza przejście z poziomu „rozmowy z biznesem” do kodu, ale ostatnie słowo w kwestii nazewnictwa i granic modułów powinno pozostać po stronie zespołu.

AI w analizie istniejącego kodu i legacy – przyspieszanie orientacji w projekcie

Szybkie tworzenie mapy modułów i zależności

Przy wejściu do starego projektu największym problemem jest zrozumienie, gdzie faktycznie dzieje się logika biznesowa. Jeżeli narzędzie potrafi zaindeksować repozytorium, można poprosić je o syntetyczny opis struktury:

- główne moduły i ich odpowiedzialności,

- najważniejsze punkty wejścia (kontrolery, funkcje handlerów, joby CRON),

- miejsca, w których następuje integracja z zewnętrznymi systemami,

- najbardziej rozbudowane lub skomplikowane klasy.

Takie „mapy” nie są idealne, ale potrafią skrócić pierwszą fazę orientowania się z kilku dni do kilku godzin. W praktyce przydaje się też generowanie prostych diagramów sekwencji na podstawie wybranego flow – np. „przepływ tworzenia zamówienia od API po zapis w bazie”.

Wyjaśnianie fragmentów legacy w języku naturalnym

Fragmenty legacy często są nieudokumentowane i obudowane technicznym żargonem sprzed kilku lat. Wklejenie takiego kodu do asystenta i poproszenie o „wyjaśnienie krok po kroku, co robi ten fragment” potrafi zaoszczędzić wielu prób uruchamiania debuggera.

Przydatne są szczególnie dwa rodzaje pytań:

- „Jaki jest cel tej funkcji / klasy, z czego korzysta i co zwraca?”

- „Jakie są potencjalne skutki uboczne wywołania tej metody?” (np. zapisy w bazie, wywołania zewnętrznych API).

Odpowiedzi trzeba konfrontować z rzeczywistym zachowaniem systemu (logi, testy), ale nawet częściowo trafne streszczenie pozwala szybciej zlokalizować właściwe miejsce do modyfikacji. W większych zespołach ułatwia to też przekazywanie wiedzy między osobami – zamiast godzinnej sesji przy tablicy, nowa osoba dostaje wstępny opis z AI i dopiero potem dopytuje o szczegóły.

Wyszukiwanie powiązań i miejsc użycia danej koncepcji

Trudnym elementem pracy z legacy jest znalezienie wszystkich miejsc, w których używana jest dana koncepcja: konkretny status zamówienia, flaga konfiguracyjna czy typ wyjątku. Zwykłe wyszukiwanie tekstowe działa, ale bywa uciążliwe, gdy nazwy są niespójne albo częściowo zduplikowane.

Asystenci mają tu dwie przewagi:

- potrafią szukać po znaczeniu – można poprosić o „wszystkie miejsca, gdzie system decyduje, czy zamówienie można anulować”,

- nie ograniczają się do jednej nazwy – potrafią wykryć powiązane fragmenty na podstawie struktury i podobnych warunków logicznych.

Efekt nie jest stuprocentowo kompletny, ale często wystarczający, aby zidentyfikować najważniejsze hot-spoty, które trzeba przejrzeć przed zmianą. To szczególnie przydatne w systemach, które powstawały latami i przeszły przez wiele różnych stylów kodowania.

Streszczanie długich plików i historii zmian

Przy plikach liczących kilkaset czy kilka tysięcy linii trudno szybko zorientować się, które fragmenty są jeszcze istotne, a które zostały pozostawione „na wszelki wypadek”. Funkcje streszczania pozwalają w kilku akapitach uzyskać:

- podział na główne odpowiedzialności pliku lub klasy,

- wskazanie najdłuższych i najbardziej zagnieżdżonych metod,

- opis miejsc, które prawdopodobnie powstały w wyniku „łatanych” zmian.

Podobnie można potraktować historię commitów: AI potrafi zebrać z kilkudziesięciu wiadomości commitów główne etapy rozwoju danego modułu, zwłaszcza jeśli w wiadomościach zachowano minimum dyscypliny. Ułatwia to zrozumienie, dlaczego kod wygląda tak, jak wygląda, i gdzie wcześniej „bolało”.

AI w debugowaniu i rozwiązywaniu problemów

Analiza logów i stack trace’ów

Typowy scenariusz: aplikacja wyrzuca złożony stack trace z kilkoma przyczynami zagnieżdżonymi w środku, logi są hałaśliwe, a błąd pojawia się tylko w specyficznych warunkach produkcyjnych. Zamiast ręcznie „przeklikiwać” kolejne poziomy, można:

- wyciągnąć fragment logów z jednego cyklu błędu,

- usunąć dane wrażliwe (identyfikatory klientów, tokeny),

- przekleić logi do asystenta wraz z krótkim opisem kontekstu (np. „błąd przy próbie wysłania faktury PDF do zewnętrznego systemu”).

Model zwykle potrafi wskazać, który z wyjątków jest rzeczywistą przyczyną (root cause), a które są jedynie konsekwencją. Może też zasugerować pierwsze kroki diagnostyczne: włączenie dodatkowego logowania w konkretnym miejscu, sprawdzenie konfiguracji SSL, limitów czasowych lub nietypowych danych wejściowych.

Odwzorowywanie błędów w minimalny przykład

Skuteczne debugowanie często wymaga zbudowania minimalnego przykładu, który odtwarza błąd. Programiści zwykle robią to ręcznie, usuwając kolejne fragmenty kodu, aż problem pozostaje w małym, samodzielnym pliku. Asystent może przyspieszyć ten proces, jeśli poprosisz go o:

- wyizolowanie fragmentu odpowiedzialnego za błąd na podstawie stack trace,

i oryginalnego kodu, - zaproponowanie minimalnego skryptu lub testu, który go reprodukuje,

- wyjaśnienie, które elementy są zbędne do samej reprodukcji.

Nawet jeśli wynik nie jest idealny, często daje solidny punkt wyjścia. Dalej można już ręcznie dostosować przykład, a następnie użyć go do diagnozy lub zgłoszenia błędu w bibliotece zewnętrznej.

Sugerowanie hipotez i strategii debugowania

Przy trudnych, sporadycznych błędach cenne bywa nie tyle znalezienie gotowego rozwiązania, co zaproponowanie listy hipotez do przetestowania. Krótki opis kontekstu, konfiguracji i sposobu wywołania może posłużyć modelowi do wygenerowania kilku realistycznych scenariuszy, np.:

Warto też uwzględnić aspekt prawny i licencyjny. Kod generowany przez AI może pochodzić pośrednio z projektów open source o różnych licencjach. Serwisy typu Styropiany24 zwracają uwagę na konsekwencje używania bibliotek i fragmentów kodu z różnych źródeł. W praktyce dobrym standardem jest traktowanie sugestii AI jak przykładu z internetu: inspiracja jest dozwolona, ale o zgodność licencyjną i bezpieczeństwo odpowiada zespół.

- konflikt wersji bibliotek (wskazanie konkretnych zależności),

- różnica między ustawieniami środowiska lokalnego i produkcji,

- warunkowy kod zależny od flag kompilacji lub zmiennych środowiskowych.

Zespół zyskuje listę uporządkowanych kroków „do odhaczenia”, zamiast chaotycznego eksperymentowania. W praktyce przyspiesza to też komunikację z innymi działami (DevOps, bezpieczeństwo), bo od razu wiadomo, o co należy ich poprosić.

Interaktywne sesje „pair debugging”

Niektóre narzędzia integrują się z IDE w taki sposób, że można prowadzić z nimi quasi-interaktywną sesję debugowania: pokazujesz fragment kodu, opisujesz objaw (np. „ta funkcja czasem zwraca pustą listę, mimo że w bazie są dane”) i na bieżąco doprecyzowujesz odpowiedzi modelu, wskazując, co już sprawdziłeś.

Taki tryb pracy przypomina rozmowę z bardziej doświadczonym kolegą z zespołu: nie tyle oczekujesz gotowego patcha, co pytań naprowadzających i propozycji kolejnych eksperymentów. Szczególnie pomocne bywa to dla mniej doświadczonych programistów, którzy dopiero uczą się systematycznego podejścia do diagnozowania.

Code review wspierane przez sztuczną inteligencję

Automatyczne podsumowania zmian w pull requestach

Przy większych pull requestach pierwszy kontakt z diffem bywa przytłaczający. Narzędzia oparte na AI potrafią na podstawie różnic między gałęziami:

- streszczać główne zmiany w kilku punktach,

- wskazać pliki, w których zmieniła się logika biznesowa, a nie tylko formatowanie,

- zidentyfikować potencjalne skutki uboczne (np. zmiany w walidacji danych).

Dzięki temu recenzent szybciej decyduje, które fragmenty wymagają szczególnie uważnego przejrzenia, a które można przelecieć pobieżnie. W zespołach z intensywnym ruchem PR-ów ma to wymierny wpływ na obciążenie seniorów.

Wychwytywanie wzorców błędów i ryzykownych konstrukcji

Modele, które analizują kod podczas review, potrafią z dużym prawdopodobieństwem wskazać konstrukcje, które często bywają źródłem problemów. Chodzi na przykład o:

- brak obsługi wyjątków w miejscach integracji z zewnętrznym API,

- operacje na współdzielonych strukturach bez synchronizacji,

- niebezpieczne użycie funkcji parsujących (np. bez limitu rozmiaru danych),

- nadmiernie skomplikowane warunki logiczne.

AI zwykle nie rozumie pełnego kontekstu domenowego, ale jest dobrym „wykrywaczem dymu” – sygnalizuje miejsca, w których z dużą szansą przydałby się dodatkowy test lub komentarz. Ostatnia decyzja należy jednak do recenzenta, który zna ograniczenia systemu i kompromisy przyjęte w zespole.

Propozycje poprawek i komentarzy review

Narzędzia code review z AI potrafią nie tylko wskazać potencjalny problem, lecz także zaproponować konkretną poprawkę wraz z wyjaśnieniem. W prostych przypadkach (wektor N+1 w ORM, niespójne nazewnictwo, pominięty null-check) można zaakceptować taką sugestię niemal od razu.

Przy bardziej złożonych tematach przydaje się generowanie komentarzy „w imieniu” recenzenta. Zamiast pisać od zera dłuższe uwagi, można poprosić narzędzie o:

- wyjaśnienie, dlaczego dana konstrukcja jest ryzykowna,

- zaproponowanie bardziej czytelnego wariantu kodu,

- dodanie linku do wewnętrznego standardu lub dokumentacji.

Recenzent powinien taki komentarz przeczytać i dostosować ton do kultury zespołu, jednak samo zredagowanie treści zajmuje wtedy znacznie mniej czasu. W efekcie feedback jest pełniejszy i bardziej zrozumiały, zwłaszcza dla młodszych programistów.

Standaryzacja stylu i najlepszych praktyk w zespole

W większych organizacjach sporo energii pochłania pilnowanie zgodności ze standardami: konwencje nazewnictwa, struktura warstw, sposób obsługi błędów. AI może pełnić rolę „strażnika stylu”, pod warunkiem że ma dostęp do odpowiednich reguł lub przykładów kodu uznawanego za wzorcowy.

W praktyce polega to na tym, że dla wybranych modułów przygotowuje się kilka reprezentatywnych plików, a następnie model jest instruowany, aby przy code review porównywał nowe zmiany do tych wzorców. Wtedy komentarze nie są ogólne („ten kod jest nieczytelny”), lecz odwołują się do konkretnych ustaleń: „w tym projekcie walidację danych wejściowych realizujemy w warstwie X, a nie w kontrolerach”.

Testy, scenariusze edge-case i refaktoryzacja z pomocą AI

Generowanie testów jednostkowych i integracyjnych

Tworzenie testów bywa postrzegane jako żmudne, choć to one w praktyce chronią przed regresją. AI nadaje się szczególnie do:

- proponowania zestawu przypadków testowych na podstawie implementacji,

- generowania szkieletów testów w używanym frameworku (JUnit, pytest, Jest itp.),

- uzupełniania danych testowych i asercji.

Uzupełnianie istniejących testów i pokrycia krytycznych ścieżek

Same szkielety testów to początek. Przy realnych projektach większym problemem bywa to, że testy omijają ścieżki brzegowe i nietypowe kombinacje danych. AI dobrze sprawdza się jako „drugi komplet oczu” przy analizie istniejącego zestawu testów. Można:

- przekleić klasę lub moduł wraz z aktualnymi testami,

- dodać informację o tym, które scenariusze biznesowe są kluczowe (np. obsługa płatności odrzuconych po stronie banku),

- poprosić o wskazanie brakujących przypadków oraz przykładowych danych wejściowych.

Model często wychwytuje luki typu: brak testu na puste kolekcje, nietypowe znaki w danych użytkownika, przekroczenie limitów (maksymalna długość pola, duża liczba elementów). W prostszych fragmentach kodu można od razu przyjąć zaproponowane testy, w bardziej wrażliwych obszarach służą one raczej jako lista inspiracji do ręcznej doprecyzowania.

Projektowanie testów pod regresje i bugfixy

Każdy naprawiony błąd powinien, co do zasady, doczekać się testu, który zabezpieczy przed jego powrotem. W praktyce przy dużej presji czasowej bywa z tym różnie. AI pozwala skrócić drogę od znalezionego błędu do gotowego testu regresyjnego. Wystarczy przekazać:

- fragment kodu przed poprawką i po poprawce,

- opis tego, co wcześniej działało nieprawidłowo (np. „przy kwocie 0 zł system w ogóle nie zapisywał zamówienia”),

- informację o używanym frameworku testowym.

Na tej podstawie można uzyskać propozycję testu, który odtwarza dawną nieprawidłowość i sprawdza właściwe działanie po zmianie. Istotne jest, by samodzielnie upewnić się, że test rzeczywiście „czerwieniłby się” w starej wersji i „zazielenia” w nowej – to pozostaje odpowiedzialnością programisty, a nie modelu.

Symulowanie scenariuszy edge-case i nieoczywistych kombinacji

Najgroźniejsze błędy wynikają zwykle z nietypowego złożenia kilku warunków: konkretnej konfiguracji, danych na granicy akceptowalnych wartości i obciążenia systemu. W generowaniu takich pomysłów AI jest często sprawniejsze niż pojedynczy członek zespołu, bo korzysta z szerokiego „doświadczenia” z różnych projektów.

Przydaje się to szczególnie w obszarach typu:

- płatności i rozliczenia (różne strefy czasowe, zmiany czasu, waluty),

- import i eksport danych (uszkodzone pliki, brakujące nagłówki, mieszane kodowania),

- komunikacja z zewnętrznymi API (limity throttlingu, opóźnienia, częściowe odpowiedzi).

Przekazując modelowi opis interfejsu, kontraktu API lub format danych, można poprosić o listę przypadków granicznych wraz z próbkami danych. Część z nich będzie przesadzona lub mało realistyczna, ale kilka potrafi od razu ujawnić dziury w walidacji lub brak obsługi określonych wyjątków.

Refaktoryzacja krok po kroku z użyciem AI

Refaktoryzacja dużych modułów bez testów jednostkowych jest ryzykowna. AI nie usuwa tego ryzyka, ale może je pomóc kontrolować i ograniczyć liczbę „manualnej” pracy. Typowy tryb działania wygląda następująco:

Jeśli chcesz pójść krok dalej, pomocny może być też wpis: Jak zacząć edukację leśną w przedszkolu: praktyczny przewodnik dla rodziców i nauczycieli.

- Na początku prosisz model o wskazanie głównych odpowiedzialności klasy lub modułu i zaproponowanie logicznego podziału na mniejsze komponenty.

- Następnie, dla każdego sugerowanego komponentu, generujesz propozycję nowego interfejsu (sygnatury metod, typy parametrów, zwracane wartości).

- Później – już iteracyjnie – prosisz AI o przepisywanie pojedynczych metod do nowej struktury, pilnując, by każdy krok dało się skompilować i uruchomić.

Przy takim podejściu narzędzie pełni rolę pomocnika „przepisywacza”, a nie autonomicznego projektanta architektury. Kluczowe decyzje – co zostaje, co wydzielamy, jakie abstrahcje mają sens w danym kontekście biznesowym – pozostają po stronie człowieka.

Wyszukiwanie duplikacji i wzorców do wydzielenia

W większych bazach kodu część refaktoryzacji polega na wyszukiwaniu powtarzających się fragmentów i ich uogólnieniu. Standardowe narzędzia (np. detektory duplikacji) działają głównie tekstowo, podczas gdy AI może patrzeć bardziej na poziomie znaczenia.

Przykładowy scenariusz:

- przekazujesz kilka plików, w których „intuicyjnie” czujesz powielanie logiki (np. obsługa kilku typów raportów),

- prosisz o opisanie, które fragmenty wykonują podobne operacje na danych, choć używają innych nazw lub struktur,

- na podstawie tej analizy model proponuje wspólną abstrakcję – np. interfejs raportu lub klasę bazową.

Część sugestii będzie zbyt ogólna, ale nawet wtedy pozwala uporządkować myślenie: jasno widać, gdzie faktycznie mamy kopię-wklej, a gdzie jedynie pozory podobieństwa.

Kontrola technicznego długu przy refaktoryzacji

Refaktoryzacja to dobry moment, by świadomie decydować, który dług techniczny spłacamy, a który pozostawiamy na później. AI może działać jako narzędzie wspierające priorytetyzację. Na podstawie kilku klas lub modułów:

- tworzy listę problemów wraz z orientacyjnym wpływem na czytelność i możliwość zmian (np. „silne sprzężenie między modułami A i B utrudnia testowanie”),

- podpowiada, które zmiany są niskokosztowe, a przynoszą wyraźną poprawę (np. wydzielenie stałych, uproszczenie zagnieżdżonych warunków),

- wskazuje obszary, które lepiej pozostawić na dedykowaną iterację (np. pełna zmiana modelu danych).

Dzięki temu refaktoryzacja nie zamienia się w niekontrolowaną przebudowę wszystkiego naraz, lecz pozostaje serią świadomych, małych kroków, popartych argumentami, które łatwo przedstawić reszcie zespołu.

Dokumentacja, komentarze i komunikacja z biznesem wspierana AI

Generowanie opisów modułów i architektury na podstawie kodu

Utrzymanie aktualnej dokumentacji technicznej jest jednym z najbardziej zaniedbywanych obszarów. AI znacząco obniża próg wejścia, bo pozwala w kilka minut przygotować pierwszą wersję opisu, zamiast zaczynać od pustej strony.

W praktyce wygląda to tak, że:

- przekazujesz wybrane pliki lub całe podkatalogi (np. warstwę „billing” albo „import danych”),

- dodajesz zwięzły opis domeny w kilku zdaniach,

- prosisz o przygotowanie dokumentu opisującego odpowiedzialności modułów, główne przepływy i punkty integracji.

Powstały tekst wymaga zwykle doprecyzowania i korekty, ale daje strukturę: sekcje, nagłówki, propozycje diagramów. Dzięki temu programista w praktyce spędza czas na poprawianiu i uszczegóławianiu, a nie na walce z „białą kartką”.

Tworzenie i ujednolicanie komentarzy w kodzie

Komentarze bywają zbyt lakoniczne albo zupełnie zbędnie powtarzają to, co już jasno wynika z nazw. AI pomaga znaleźć środek: komentarze, które tłumaczą „dlaczego” zamiast „co”. Aby to osiągnąć, można:

- zaznaczyć fragmenty kodu, które są nieintuicyjne lub wynikają z ograniczeń zewnętrznych systemów,

- poprosić o krótki komentarz wyjaśniający powód takiego rozwiązania,

- określić maksymalną długość komentarza (np. jedno–dwa zdania).

Warto przy tym jasno wskazać preferencje: czy komentarze mają być po polsku, czy po angielsku, w jakim tonie i stylu. Po kilku iteracjach narzędzie zaczyna „trafiać” w standard przyjęty w zespole, a recenzent skupia się na merytoryce, nie na formie.

Automatyczne podsumowania zmian dla interesariuszy biznesowych

Część zespołów przygotowuje krótkie raporty z releasów dla osób spoza IT: product ownerów, działu obsługi klienta, sprzedaży. Ręczne tłumaczenie listy commitów na język biznesowy jest czasochłonne. AI potrafi w tym zakresie przyspieszyć pracę, o ile dostanie odpowiednie wejście.

Typowe wejście obejmuje:

- listę biletów z systemu typu Jira lub Azure DevOps,

- krótkie opisy spodziewanego wpływu na użytkowników,

- ewentualnie fragmenty changeloga technicznego.

Na tej podstawie model generuje zwięzłe podsumowanie w języku zrozumiałym dla biznesu, zorientowane na efekty (np. „przyspieszono proces wystawiania faktur przy dużej liczbie pozycji”, „dodano możliwość eksportu raportu do Excela”). Programista lub product owner edytuje je pod kątem dokładności i priorytetów, ale nie musi już zaczynać od zera.

Przekład między językiem technicznym a biznesowym

Konflikty przy współpracy z biznesem wynikają często z niedopasowania języka. Programista mówi o „indeksach w bazie” i „limitach przepustowości API”, podczas gdy właściciel biznesowy myśli o czasie oczekiwania klienta na ekranie i ryzyku utraty zamówień. AI może pełnić rolę tłumacza między tymi światami.

Możliwe są dwa kierunki pracy:

- „Z góry w dół” – z briefu biznesowego generujesz szkic specyfikacji technicznej, w której model proponuje możliwe podejścia, listę zależności i pytania doprecyzowujące.

- „Z dołu do góry” – z opisu technicznego lub fragmentu kodu uzyskujesz opis wpływu na użytkownika końcowego, w języku, który można wkleić np. do dokumentacji produktu.

Dzięki temu łatwiej przygotować się do spotkań, zbudować wspólną mapę pojęć i uniknąć sytuacji, w której obie strony mówią o tym samym, ale używają zupełnie innych terminów.

Porządkowanie i aktualizacja istniejącej dokumentacji

W wielu projektach istniejące dokumenty są częściowo nieaktualne, niespójne lub rozproszone. AI pomaga uporządkować ten materiał, szczególnie gdy chodzi o:

- scalenie kilku podobnych dokumentów w jedną, spójną całość,

- oznaczenie fragmentów, które są sprzeczne z obecnym stanem kodu lub konfiguracji,

- wskazanie brakujących sekcji (np. opis retry policy, limity czasowe, ograniczenia skalowalności).

W praktyce wygodnie jest przekazać narzędziu kilka plików tekstowych lub markdown i poprosić o stworzenie zarysu „jednego” dokumentu referencyjnego wraz z listą pytań, które trzeba wyjaśnić w zespole. Taka lista pytań często ujawnia obszary, w których wiedza tkwi tylko w głowach pojedynczych osób, co z perspektywy ciągłości systemu bywa istotnym ryzykiem.

Wsparcie przy komunikacji w rozproszonych zespołach

W zespołach międzynarodowych standardem staje się komunikacja po angielsku – zarówno w dokumentacji, jak i na kanałach typu Slack. AI ułatwia dopracowanie wypowiedzi, szczególnie gdy ktoś nie czuje się pewnie w języku obcym. Można:

- napisać roboczą wersję komentarza lub opisu zadania po polsku,

- poprosić model o przełożenie na angielski w neutralnym, rzeczowym tonie,

- wskazać, czy komunikat ma być bardziej formalny, czy swobodny.

Działa to także w drugą stronę: z rozbudowanej dyskusji na kanale zespołowym da się wygenerować krótkie podsumowanie ustaleń, które następnie trafia do ticketu lub dokumentacji. Dzięki temu mniej treści „gubi się” w historii czatu, a nowi członkowie zespołu szybciej orientują się w kontekście podjętych decyzji.

Najczęściej zadawane pytania (FAQ)

Jak konkretnie sztuczna inteligencja zmienia codzienną pracę programisty?

Codzienna praca przesuwa się z ręcznego pisania dużych fragmentów kodu w stronę formułowania precyzyjnych poleceń dla narzędzi AI, oceny wygenerowanych propozycji i ich dopasowywania do projektu. Zamiast godzin spędzonych na wyszukiwaniu przykładów w sieci, programista częściej kuratoruje kod, projektuje rozwiązania i analizuje konsekwencje techniczne.

W praktyce oznacza to, że więcej czasu zajmuje projektowanie architektury, interfejsów, struktur danych i procesów integracji, a mniej – „ręczne” tworzenie powtarzalnych fragmentów. AI przejmuje część zadań operacyjnych, ale decyzje projektowe i odpowiedzialność za całość systemu pozostają po stronie człowieka.

Czy AI zastąpi programistów, czy raczej zmieni ich rolę?

Obecnie AI nie zastępuje programistów, lecz zmienia charakter ich pracy. Modele językowe generują kod na podstawie wzorców, ale nie rozumieją kontekstu biznesowego, historii projektu ani całej architektury w taki sposób, jak robi to doświadczony inżynier. Co do zasady największą wartością programisty staje się umiejętność zadania dobrego pytania, zdefiniowania problemu i oceny jakości rozwiązania.

W dłuższej perspektywie rola przesuwa się z „kodera” na projektanta rozwiązań i strażnika jakości. Osoba, która zna domenę, potrafi przewidzieć skutki uboczne zmian i świadomie zaplanować rozwój systemu, nadal jest niezbędna, nawet jeśli część kodu powstaje półautomatycznie.

Jak AI wpływa na juniorów, midów i seniorów w zespole developerskim?

Juniorzy zyskują stały dostęp do „mentora na żądanie” – AI tłumaczy koncepcje, podpowiada przykłady, pomaga czytać obcy kod. Ryzyko polega na tym, że część osób zaczyna bezrefleksyjnie kopiować podpowiedzi zamiast budować solidne fundamenty. Dlatego szczególnie na początku kariery potrzebna jest świadoma nauka, a nie tylko korzystanie z generatora rozwiązań.

Mid developerzy zwykle notują największy wzrost produktywności. Umieją już rozpoznać słabe propozycje AI, więc wykorzystują asystentów do generowania szkieletów kodu, testów czy szybkiego researchu. Seniorzy natomiast coraz częściej używają AI do analizy: przeglądu kodu, refaktoryzacji, oceny ryzyk i weryfikacji decyzji architektonicznych. Dla nich narzędzia AI są raczej wsparciem w kontroli jakości niż „maszyną do pisania funkcji”.

Do jakich zadań AI w programowaniu sprawdza się najlepiej, a gdzie nadal zawodzi?

AI bardzo dobrze radzi sobie z zadaniami powtarzalnymi i jasno opisanymi, takimi jak:

- generowanie kodu CRUD, DTO, mapperów i konfiguracji,

- pisanie testów jednostkowych na podstawie istniejących funkcji,

- przepisywanie kodu między językami lub frameworkami,

- podpowiedzi składni i prostych algorytmów.

Znacznie gorzej działa tam, gdzie trzeba uwzględnić specyficzny kontekst biznesowy, niepełne wymagania lub długoterminowe skutki decyzji. Model nie zna polityk bezpieczeństwa organizacji, niuansów domeny ani niepisanych ustaleń w zespole. W takich miejscach propozycje AI wymagają szczególnie uważnej weryfikacji, a ostateczne decyzje powinny zapadać po stronie człowieka.

Jak bezpiecznie korzystać z AI w pracy nad kodem (błędy, „halucynacje”, kontekst)?

Podstawowa zasada brzmi: żadna odpowiedź AI nie powinna być przyjmowana „na wiarę”. Modele językowe potrafią generować pozornie poprawny, ale błędny kod lub wymyślone informacje, zwłaszcza przy bardziej złożonych problemach. Konieczna jest kontrola: uruchomienie testów, porównanie z dokumentacją, przejrzenie logiki linijka po linijce przy kluczowych fragmentach.

Dodatkowo narzędzia mają ograniczone okno kontekstu – widzą tylko część projektu. Jeżeli asystent nie ma dostępu do całego repozytorium, może proponować rozwiązania sprzeczne z istniejącą architekturą albo dublujące logikę. W praktyce warto łączyć automatyczne generowanie z konsekwentnym code review i utrzymywaniem spójnej dokumentacji, z której AI może korzystać.

Jakie narzędzia AI są najczęściej używane przez programistów i czym się różnią?

Najczęściej spotyka się cztery grupy narzędzi. Po pierwsze, wtyczki do IDE (np. dla VS Code czy IntelliJ), które podpowiadają kod „inline”, generują funkcje i testy bezpośrednio w edytorze. Po drugie, chatboty i asystenci konwersacyjni w przeglądarce, które lepiej sprawdzają się przy dłuższych rozmowach o architekturze, refaktoryzacji czy tłumaczeniu fragmentów kodu.

Po trzecie, wyspecjalizowane narzędzia webowe, np. do generowania dokumentacji, diagramów czy analizy logów. Po czwarte, integracje przez API, które podłącza się do CI/CD, aby automatycznie streszczać pull requesty, generować opisy wydań czy etykiety zadań. Wybór zależy od kultury i polityki organizacji – część firm dopuszcza zewnętrzne usługi, inne tworzą własne, zamknięte instancje modeli.

Czym różni się „lokalny” a „globalny” kontekst projektu w narzędziach AI?

Lokalny kontekst to zwykle bieżący plik, kilka sąsiednich klas lub fragment aktualnej funkcji. Na tej podstawie model potrafi dość precyzyjnie dopisać kolejną metodę czy zaproponować test. Globalny kontekst obejmuje natomiast całe repozytorium, historię decyzji architektonicznych, zależności między modułami i wymagania biznesowe.

Większość narzędzi AI operuje głównie na lokalnym kontekście, ponieważ długość wejścia do modelu jest ograniczona. Bardziej zaawansowane rozwiązania indeksują kod, dokumentację i commity, a potem tworzą streszczenia, które przekazują modelowi. Nawet wtedy można mówić jedynie o przybliżonym obrazie projektu, co uzasadnia ostrożność przy akceptowaniu większych zmian generowanych automatycznie.